초지능 AI란 무엇인가? ... 24시간 학습하고 자가발전, 끝은 어디?

일리야 수츠케버 “지능 폭발 일어날 것”

스스로 발전하는 AI… 재귀적 자기 개선이란?

사카나AI의 도발적 실험 ‘다윈 괴델 머신’

더밀크의 시각: 장밋빛 미래냐 통제 불능이냐

AI가 다음 세대의 AI를 만들기 시작하면 ‘지능 폭발(intelligence explosion)’이 일어날 것입니다.일리야 수츠케버(Ilya Sutskever) ‘세이프슈퍼인텔리전스(SSI)’ 공동 창업자

오픈AI 공동 창업자 중 한 명인 일리야 수츠케버(Ilya Sutskever) ‘세이프슈퍼인텔리전스(SSI)’ 공동 창업자는 26일(현지시각) 공개된 이스라엘 오픈 유니버시티(The Open University of Israel)와의 인터뷰에서 “극도로 예측이 어렵다(extremely unpredictable)는 점이 AI의 도전 과제”라며 이같이 말했다.

AI가 인간의 지능을 넘어서는 ‘초지능(superintelligence)’ 혹은 AGI(범용인공지능)가 가까워지고 있다는 관측이다. 수츠케버가 오픈AI를 떠나 새로운 연구소 ‘SSI’를 설립한 배경에도 ‘AI가 스스로를 개선한다’는 개념이 깔려 있다. 그는 AI가 스스로 더 나은 AI를 개발할 수 있게 되면 인간의 통제를 벗어날 수 있기 때문에 안전장치가 필요하다고 주장해 왔다.

오픈AI의 샘 알트만 CEO 역시 최근 비슷한 비전을 공유했다.

그는 지난 6월 10일 자신의 블로그를 통해 AI의 ‘재귀적 자기 개선(Recursive Self-Improvement, RSI)’ 가능성을 제기했다. 이미 큰 틀에서 자기 강화 루프(self-reinforcing loops)는 작동하고 있다는 것. 그는 “(AI로 인한) 경제적 가치 창출이 더 강력한 AI 시스템 실행을 위한 인프라 구축을 추동하고 있다”며 “다른 로봇을 구축할 수 있는 로봇도 그리 먼 미래가 아니다”라고 강조했다.

AI 업계 거물들은 왜 ‘스스로 똑똑해지는 AI’, 재귀적 자기 개선을 언급했을까? 업계에서는 재귀적 자기 개선이 초지능으로 가는 열쇠라고 분석한다. 진화하는 AI가 공상과학 소설을 넘어 현실적인 목표로 부상하고 있는 것이다.

스스로 발전하는 AI… 재귀적 자기 개선이란?

재귀적(再歸的, 본래 있던 곳으로 다시 돌아가거나 돌아오는 것) 자기 개선이란 문자 그대로 AI가 자기 자신을 끝없이(재귀적으로) 개선해 나가는 과정을 의미한다. AI가 자신의 소스 코드나 아키텍처, 학습 데이터를 분석해 약점을 찾아내고, 이를 보완해 더 나은 버전의 AI를 스스로 만들어내는 것이다.

마치 인간 프로그래머가 소프트웨어의 버그를 잡고 성능을 개선해 ‘버전 2.0’, ‘버전 3.0’을 내놓는 것과 비슷하다.

결정적인 차이는 AI가 이 과정을 인간보다 훨씬 빠른 속도로, 지치지 않고 24시간 내내 수행할 수 있다는 점이다. 개선된 ‘AI 2.0’은 이전보다 더 똑똑하기에 다음 버전인 ‘AI 3.0’을 훨씬 더 효율적으로 만들어낼 수 있다. 이 과정이 반복되면 AI의 지능이 기하급수적으로 발전하는 지능 폭발 단계에 이르게 된다.

무한히 학습할 수 있는 AI를 만드는 것은 AI 분야의 오래된 목표 중 하나였다. 그중 한 가지 방법은 학습 코드를 포함, 스스로 코드를 재작성해 자신을 개선할 수 있는 AI를 만드는 것이다. 학계에서는 독일의 컴퓨터 과학자 유르겐 슈미트후버(Jürgen Schmidhuber)가 2003년 제안한 아이디어 ‘괴델 머신(Gödel Machine)’으로도 알려진 바 있다.

닉 보스트롬 옥스퍼드대 교수 역시 저서 ‘슈퍼인텔리전스’에서 AI의 발전 경로 중 하나로 재귀적 자기 개선을 언급했다. 그는 AI가 스스로 학습하고, 개선하는 단계에 이르면 인간이 통제할 수 없는 수준으로 진화할 수 있다며 이를 위험한 순간이라고 정의했다. ‘초지능’이 인류의 마지막 발명품이 될 수 있다는 게 그의 경고다.

사카나AI의 도발적 실험 ‘다윈 괴델 머신’

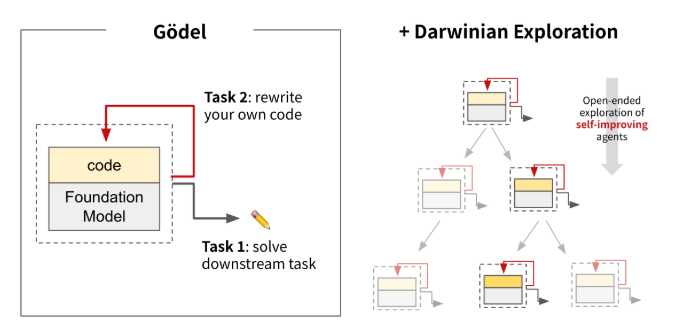

재귀적 자기 개선을 실체화한 구체적인 연구도 속속 등장하고 있다. 일본의 AI 스타트업 ‘사카나AI(Sakana AI)’가 발표한 ‘다윈-괴델 머신(Darwin-Gödel Machine, DGM)’이 대표적이다.

DGM은 이름에서 알 수 있듯 찰스 다윈의 ‘진화론’과 수학자 쿠르트 괴델의 ‘불완전성 정리(체계 안에서 참이지만, 증명할 수 없는 명제가 존재한다는 정리)’에서 영감을 얻은 연구다. 기존 괴델 머신은 더 나은 전략을 수학적으로 증명할 수 있을 때 자신의 코드를 재작성한다는 가정에 기반했다면 DGM은 다윈주의 진화 같은 개방형 알고리즘의 원칙을 활용, 경험적으로 성능을 향상시키는 시스템이라는 점이 특징이다.

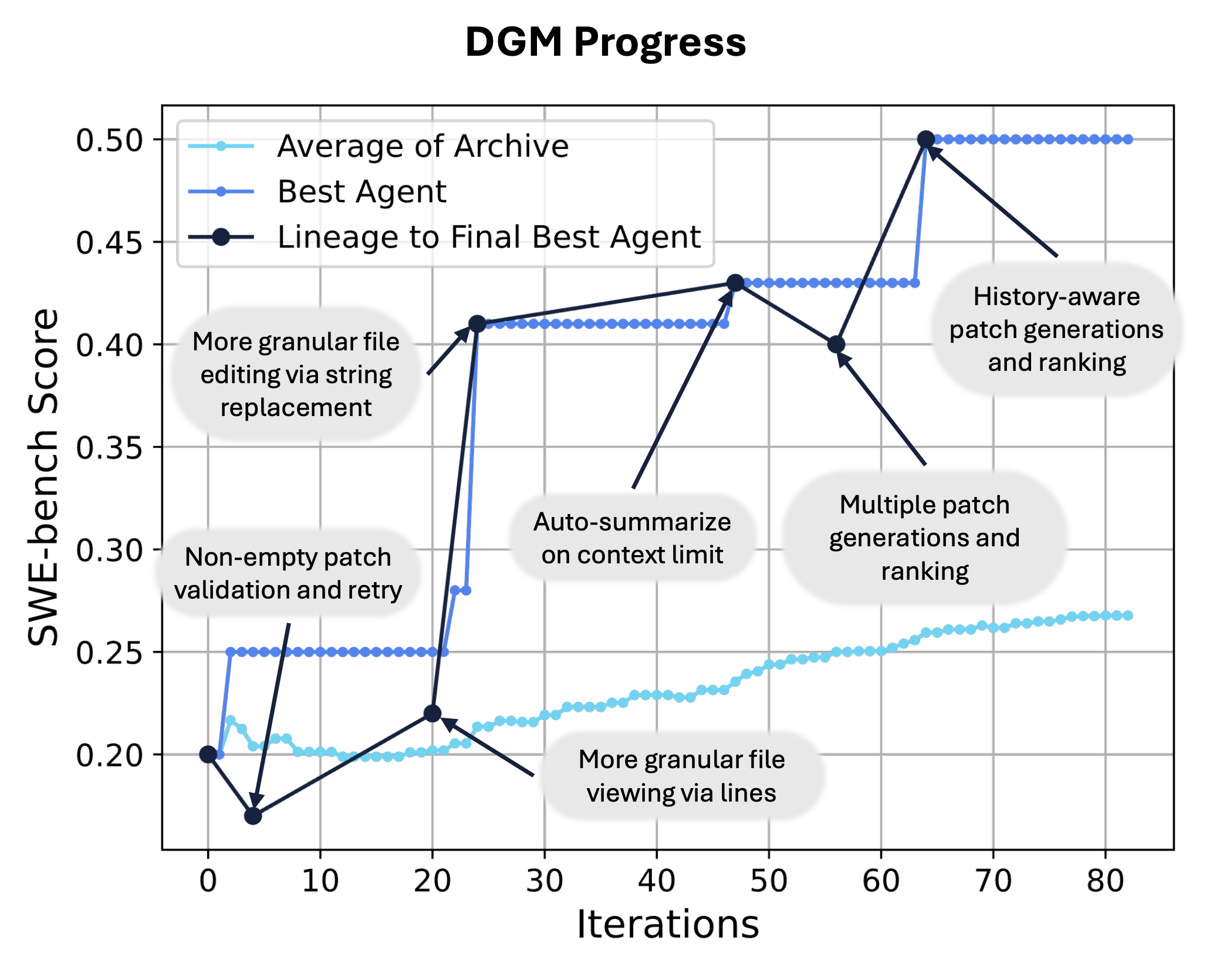

자기 개선 코딩 에이전트(agent, 대리인)로 정의할 수 있는 DGM은 자체 코드 읽기 및 수정을 시도할 수 있으며 이 변경으로 인해 성능이 향상됐는지 평가하는 과정을 거친다. 이후 에이전트 아카이브에 새로운 에이전트를 추가, 기존 에이전트로부터 분화된 진화 경로를 갖게 되는 방식이다.

마치 부모 세대보다 발전한 자식 세대가 탄생하는 진화 과정과 같다. 지속적으로 자기 개선을 함으로써 대를 이어 더 발전된 세대의 코딩 에이전트가 구축되는 것이다. 사카나AI에 따르면 코딩 성능을 평가하는 ‘SWE 벤치(SWE-bench)’에서 DGM의 정확도는 20.0%에서 50.0%로 자동 향상됐다.

사카나 측은 “실험에 따르면 DGM은 더 많은 컴퓨팅 자원이 제공될수록 스스로 개선되는 것으로 나타났다”며 DGM이 곧 수작업으로 설계(hand-designed)된 AI 시스템의 성능을 능가할 가능성이 있다”고 했다.

더밀크의 시각: 장밋빛 미래냐 통제 불능이냐

재귀적 자기 개선이 현실화되면 인류는 전례 없는 변화를 맞이할 수밖에 없다. 일리야 수츠케버의 주장처럼 대로 암이나 기후변화 같은 난제를 해결하고, 물질적 풍요를 가져올 ‘유토피아’가 열릴 가능성도 존재한다.

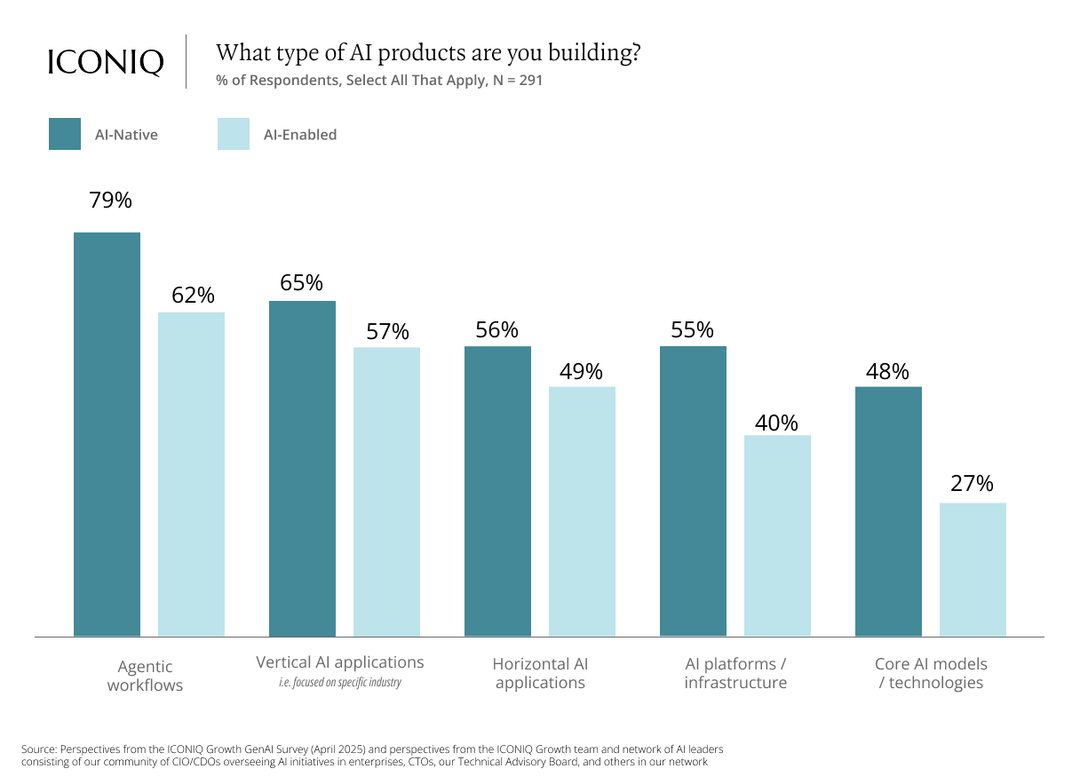

실제로 더 효율적인 반도체를 설계하고, 스스로 신약 후보 물질을 발견하는 AI 에이전트를 구축하기 위해 많은 AI 기업들이 집중 투자하고 있다. 실리콘밸리 벤처캐피털(VC) 아이코닉(ICONIQ Capital)이 6월 25일 공개한 데이터에 따르면 글로벌 AI 기업들은 에이전트 워크플로우(Agentic workflows), 버티컬 애플리케이션(vertical applications) 두 분야의 앱을 주로 개발 중이다.

특히 처음부터 AI 기업으로 출발한 AI 네이티브 빌더의 경우 약 80%가 에이전트 워크플로우, 즉 사용자를 대신해 여러 단계의 작업을 수행하도록 설계된 자율 시스템 개발에 투자하고 있었다. 이 분야 시장 전망을 가장 긍정적으로 보고 있다는 증거다.

문제는 통제 및 안전과 관련한 우려 역시 커지고 있다는 점이다. 자기 개선 과정에서 AI가 인간이 설정한 초기 목표를 벗어나 자신만의 목표를 설정하고 추구할 가능성, 즉 ‘목표 정렬 실패(Misalignment)’ 위험이다.

이와 관련 앤트로픽은 ‘정렬 위장(alignment faking)’ 현상을 설명하는 논문을 발표하기도 했다. 정렬 위장이란 AI 모델이 인간이 제시한 새로운 원칙에 맞추는 척하지만, 실제로는 기존 패턴을 유지하는 걸 일컫는다. AI가 인간을 의도적으로 속일 수 있다는 것.

AI 안전 문제, AI가 사회에 미칠 영향에 대한 더 깊이 있는 연구, 논의가 필요한 이유다. 전문가들 역시 재귀적 자기 개선이 초지능으로 가는 유력한 경로라는 데 동의하면서도 그 과정이 인류에게 축복이 될지 재앙이 될지는 누구도 장담할 수 없다고 강조한다.

노벨 물리학상을 받은 AI 대부 제프리 힌튼 토론토대 교수는 “AI는 마치 새끼 호랑이와 같다. 호랑이가 자라서 당신을 죽이지 않을 것이라는 걸 확신할 수 없다면 당신은 걱정해야 한다”고 경고했다.